La historia de Windows XP.

Falta solo una semana para que Microsoft termine de colocarle el clavo final al ataúd de Windows XP que ha sido el mayor rival de Windows 7 y 8. Use Windows XP por más de una década y deje de usarlo no por ser malo sino que tenia que adaptarme a los nuevos tiempos y tecnologías, ahora quiero dedicarle algunas líneas para que conozcan su historia.

Catorce años son muchos años incluso para Windows XPEl sistema operativo fue un cambio fundamental en la historia de Microsoft y quizás su producto más importante. Fue el primer sistema operativo dirigido al mercado de masas completamente basado en Windows NT e introdujo cambios fundamentales en la interfaz que pretendían proporcionar una nueva experiencia a sus usuarios. Pero por encima de todo fue un éxito indudable.

Windows XP ha durado más que ningún otro sistema operativo de Microsoft. Diez años después de su salida nadie se acordaba de Windows 95, 98 o Me. Incluso el posterior Windows Vista ha quedado relegado antes al olvido. Pero con catorce años a sus espaldas XP ha demostrado una longevidad y resistencia extraordinarias, manteniendo aún cerca de un 30% de cuota de mercado. A escasos días del fin de su soporte es un gran momento para recordar la historia del mítico XP.

Neptune, Odyssey y el desarrollo inicial

La historia del desarrollo de Windows XP es la historia de varios proyectos previos que definirían el futuro sistema y cambiarían para siempre la forma de trabajar de Microsoft. Dos fueron los nombres en clave que pusieron el combustible: Neptune y Odyssey; y un tercero el que hizo saltar la chispa: Whistler. Tras ellos las cosas en Redmond ya no volverían a ser las mismas.

Por un lado, Neptune era el nombre en clave con el que en Redmond empezaron a denominar a la próxima versión de Windows de la rama 9x, aquella dirigida al mercado de consumo y al hogar. Su desarrollo se puso en marcha en febrero de 1999, tan sólo siete meses después de la salida al mercado de Windows 98 y con Windows Me aún en el horno. Con ellos compartía mercado objetivo pero no código base, el cual pasaría a ser Windows NT. Por otro lado, el nombre de Odysseyescondía la otra versión de Windows en desarrollo, la de la rama NT orientada al mercado profesional y a las empresas. El proyecto fue puesto en marcha el mismo año 1999 y, al igual que Neptune, estaba basado en Windows 2000.

Lejos de mantener dos ramas de desarrollo por separado, Whistler modificó el funcionamiento de la división de Windows y únifico esfuerzos en un solo sistema

El tiempo terminó de dejar claro que no tenía sentido mantener las dos ramas de desarrollo por separado y antes de que terminase el año los de Redmond pusieron las cosas en su sitio. Neptune y Odyssey apenas se habían dejado ver, y menos públicamente, pero en diciembre de 1999 terminaría su recorrido. La dirección de Microsoft recibió a los empleados a la vuelta de las vacaciones de navidad con un memorándum interno en el que explicaba la unificación de las dos ramas de desarrollo de Windows bajo un nuevo proyecto con el nombre de Whistler, localidad donde esquiaban muchos de los empleados de la compañía.

Whistler modificó el funcionamiento de la división de Windows. En vez de desarrollar un sistema para cada sector del mercado Microsoft había entendido que las dos áreas se interrelacionaban y era necesario un sistema capaz de servir en los dos ámbitos: doméstico y profesional. Con los esfuerzos concentrados en un único sistema el equipo de desarrollo podría concentrarse en uno acorde con el nuevo milenio. Serían años en los que millones de usuarios adquirirían ordenadores personales y comenzarían a acceder a internet. El próximo Windows debería estar preparado.

Whistler, entretejiendo un sistema moderno

Bill Gates reveló al mundo la existencia de Whistler a finales de abril del año 2000 en la conferencia WinHEC. Con su presentación Gates, que ya no ocupaba el cargo de CEO en Microsoft, desveló las intenciones de su compañía de crear un sistema moderno, robusto y optimizado para todos los ámbitos. En Redmond empezaban a tomarse en serio los cambios en la interfaz y en la experiencia de usuario y por delante tendrían un año para demostrarlo.

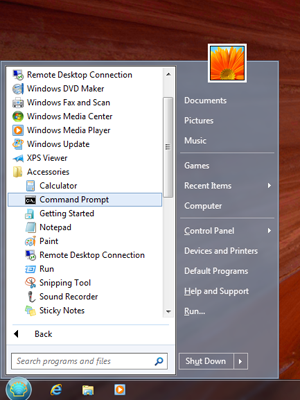

El 24 de mayo empezó la fase de pruebas de Whistler con el envió de las primeras invitaciones a su beta técnica. A partir de ahí empezaron a llegar periódicas builds en las que los de Redmond iban añadiendo los elementos que constituirían el futuro de su sistema operativo: un nuevo menú de inicio a dos columnas que sustituía la menú clásico, una nueva organización del espacio de usuario con la llegada de Mis Documentos y demás carpetas, un nuevo Panel de Control, etc. Todas esas novedades tenían en común un nuevo modo de entender la experiencia con Windows, basada en las diferentes tareas y acciones que el usuario medio realizaba con su ordenador personal.

El cambio que ya se entreveía era aún más profundo en las tripas del sistema. La nueva base de NT proporcionaba estabilidad al sistema pero exigía un arduo trabajo para asegurar la compatibilidad de hardware y software, asunto que pronto se convirtió en prioridad en Redmond. Las builds siguientes ahondaron en ello e incorporaron el centro de compatibilidad que pretendía facilitar la tarea a los usuarios a la hora de buscar hardware compatible. La renovada interfaz tuvo que esperar.

Microsoft quería cambiar la experiencia que los usuarios tenían con Windows. Whistler debía ser más amigable y cálido para el usuario y para ello era necesaria una nueva interfaz. Builds previas y la Beta 1 de octubre habían ido revelando detalles de lo que en Redmond preparaban, pero hubo que esperar hasta los primeros meses de 2001 para empezar a ver el resultado.

Una nueva interfaz para una nueva “eXPeriencia”

En la keynote del CES del 5 de enero de 2001, más recordada por la presentación de Xbox, Bill Gates mostró al mundo los primeros retazos de la nueva interfaz de Whistler. Ahí estaba la nueva pantalla de bienvenida, la opción de múltiples cuentas de usuarios o el nuevo menú de inicio. El cambio era significativo pero no radical. Microsoft se aseguró de conservar múltiples similitudes con las versiones previas de Windows sin renunciar a la introducción de una nueva experiencia.

La mejora de la experiencia se convirtió en el leitmotiv de Whistler. Conforme se sucedían las builds, las primeras semanas de 2001 dejaron claro que el desarrollo del nuevo sistema se estaba acelerando. Con el objetivo de salida al mercado puesto en la segunda mitad del año, Microsoft necesitaba un nombre para su próximo sistema operativo y la elección se hizo pronto evidente. El 5 de febrero Microsoft anunció que Whistler llegaría al mercado con el nombre de Windows XP, etiqueta que recordaba claramente a esa nueva y mejorada “eXPeriencia” que estaban construyendo.

Con el nombre de Windows XP recién estrenado, Microsoft no tardó en mostrar al mundo su nueva interfaz ‘Luna’, más colorida y alejada de la sobriedad de Windows previos

Tan solo unos días después de estrenar nombre Microsoft presentó oficialmente lo interfaz de Windows XP al mundo el 13 de febrero de 2001 en el evento Experience Music Project (EMP) en Seattle. Ya no había marcha atrás y lo que quedaban por delante eran meses de más y más builds. Tras más de un retraso, una segunda Beta sería entregada a los testers el día 26 de marzo con un Bill Gates dejando claras las intenciones de Microsoft de construir un único sistema capaz de desenvolverse en diferentes ámbitos gracias a una nueva interfaz y a la mejorada experiencia que con ella pretendían proporcionar.

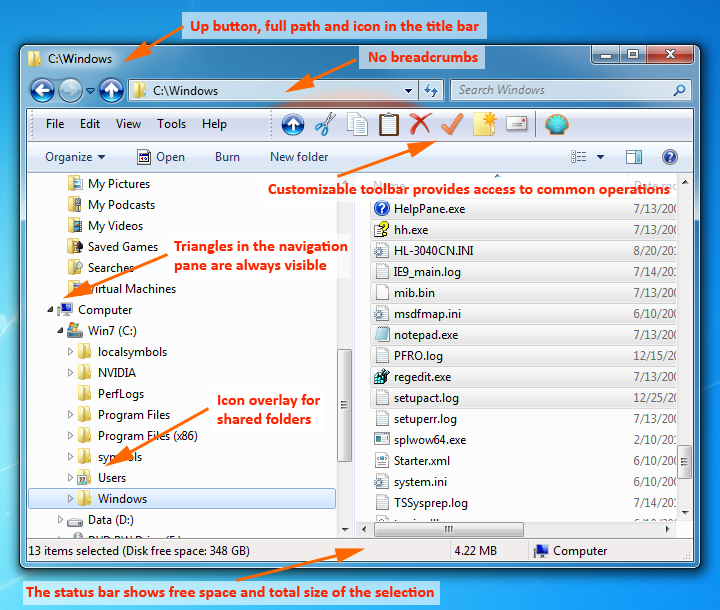

‘Luna’ fue el nombre escogido por los de Redmond para la interfaz de Windows XP. Alejada de la sobriedad de Windows 9x y 2000, el nuevo diseño del sistema despertó recelos por su supuesta inadecuación para el mercado empresarial. La gama de colores elegida y el tamaño de algunos elementos tampoco ayudaban. Microsoft tomó buena nota de las quejas y corrigió algunos de los defecto además de añadir más opciones de personalización al equipo, incluyendo un tema clásico que le devolvía al sistema operativo el aspecto de versiones previas. La resistencia al cambio siguió existiendo incluso tras la salida de Windows XP pero Luna termino por convertirse en una de las interfaces de ordenador más reconocibles de la historia.

Builds y Betas, una fase de pruebas intensa

Durante el desarrollo de Windows XP en Redmond pusieron en marcha un extenso programa de pruebas previo como nunca se había hecho hasta entonces. La llegada de la Beta 2 no hizo más que extenderlo. Microsoft distribuyó la nueva versión de prueba a través de varios canales, incluyendo el programa propio de la beta, la red de desarrolladores de Microsoft (MSDN) y TechNet. La compañía quería asegurar a toda costa el perfecto funcionamiento de Windows XP, para lo que necesitaban contar con empleados, desarrolladores, partners y consumidores. Las pruebas de Windows ya no volverían a ser una tarea meramente interna.

Builds y más builds iban apareciendo cada pocas semanas introduciendo nuevos detalles. En abril llegó la marca de Windows XP a la pantalla de bienvenida, nuevos iconos para el menú inicio y más fondos de pantalla. Entre estos últimos se encontraba Bliss, la fotografía de cielo azul y verdes colinas tomada en el Valle de Napa en Califiornia que se convertiría en el fondo de pantalla por defecto de Windows XP, y con ello en una de las fotografías más vistas de la historia.

Las builds de mayo trajeron cambios y mejoras en numerosos apartados: en los drivers de red, en el sistema de plug and play, en la gestión de energía, en los tiempos de carga, en la seguridad, etc. En junio las cosas avanzaron un poco más. Llegó Windows Messenger y la pantalla de inicio con el logo sobre fondo negro, además de los últimos retoques en la interfaz que prácticamente se dio por finalizada. Además, el 18 de junio Microsoft hizo públicos los requisitos mínimos de hardware de Windows XP: procesador Intel a 233 MHz o compatible y 128 MB de RAM; y el 21 anunció la pronta llegada de la Release Candidate 1 (RC1) de Windows XP.

El 2 de julio de 2001 Microsoft publicaría finalmente la RC1 de Windows XP, la primera versión accesible para las más de 250 mil personas que se habían apuntado al Windows XP Preview Program (WPP). Será la primera vez que todos ellas vean el nuevo sistema aumentando aún más la cifra de testers de Windows XP. En Microsoft llegaron a cifrar el número en medio millón de usuarios que proporcionaron un feedback inestimable para la compañía.

RC1, RC2 y RTM: el sprint final

Microsoft fijó el 25 de octubre de 2001 como fecha de salida de Windows XP. Hasta entonces quedaba poco camino por delante, pero los meses de verano presentaron varios retos importantes para la compañía de Redmond. Empezando por la torpeza de Amazon que el 7 de julio desvelaría la caja en la que vendría el sistema operativo al poner el sistema a la venta en su sitio web mucho antes de tiempo. Descuido que la tienda online volvería a repetir meses después. Pero los errores de Amazon eran el menor de los problemas en el verano de 2001.

Microsoft tuvo que cumplir con algunas de las medidas antimonopolio impuestas por las autoridades estadounidenses. La compañía se vio obligada a cambiar su política de licencias para los fabricantes permitiendo a estos mayor flexibilidad a la hora de configurar el sistema. Eso suponía que en el futuro podrían eliminar los accesos a Internet Explorer y Outlook e incluso sustituir el navegador por otro. Además en Redmond tuvieron que dar marcha atrás en su intención de limitar la presencia inicial de iconos en el escritorio de Windows XP y permitir a los fabricantes colocar los suyos propios.

Las modificaciones se hicieron visibles en la Release Candidate 2 (RC2) de Windows XP, liberada el 27 de julio. La nueva versión apenas incluía otras novedades y el proceso de prueba se acercaba a su final. Este se hizo efectivo el 24 de agosto de 2001 cuando Microsoft publicó la build 2600 y la declaró como RTM (Ready To Manufacturers). Con un evento en su campus de Seattle, Microsoft escenificó la entrega de Windows XP a los fabricantes, cuyos representantes recibieron copias del sistema operativo y despegaron de Redmond en helicópteros decorados con la marca XP.

En agosto de 2001 Microsoft terminó Windows XP y escenificó su entrega a los OEMs con un evento en su sede Seattle que los representantes de diversos fabricantes abandonaron en helicóptero

Los fabricantes ya podían preparar sus nuevos equipos con Windows XP y podrían ponerlos a la venta a partir del 24 de septiembre, un mes antes de la llegada oficial al mercado. Windows XP se estrenó finalmente en las tiendas el 25 de octubre de 2001. El sistema llegó a los escaparates en dos versiones principales “Home” y “Professional” dando inicio a la larga vida del mítico XP.

El tímido inicio de un sistema destinado a reinar

A pesar de la relevancia del cambio que traía consigo Windows XP, el sistema llegó al mercado de una forma más sigilosa de la esperada. Microsoft y sus socios habían preparado una campaña de marketing de mil millones de dólares para presentar Windows XP al mundo, pero los planes se vieron afectados por los efectos de los ataques del 11 de septiembre. El nivel de promoción del nuevo sistema bajo y se modificó la campaña. Microsoft llegó incluso a trasladar la presentación definitiva del sistema en la PDC de 2001 a Nueva York, en una muestra de apoyo a la ciudad.

La presentación tuvo a Bill Gates como protagonista, quién mostró su vena más humorística, concurso de“¿Quién quiere ser millonario incluido?”, mientras nos guiaba por la nueva experiencia que proporcionaba Windows XP. La interfaz Luna, el renovado menú de inicio, los centros de actividades, las nuevas carpetas, etc. Todo ello con un sistema estable y robusto adaptado a la era moderna. El sistema había evolucionado y Windows XP tenía todas las papeletas para ser un éxito de ventas.

Pero las cosas no empezaron de manera sencilla. La menor repercusión de su salida repercutió en las ventas iniciales de Windows XP. En sus primeros meses su ratio de venta llegó a ser menor que el de Windows 98. Además Microsoft tuvo mucho trabajo tratando de convencer de las bondades del cambio a un siempre reticente mercado. No faltaron las quejas por la colorida y poco seria interfaz luna, las críticas por la falta de compatibilidad con determinado hardware y software y los lamentos por los fallos de seguridad de los que adolecía el sistema.

A pesar del crítico recibimiento y la insistencia de algunos usuarios en permanecer en Windows 98 y Windows Me; Windows XP terminó por arrancar e imponerse. Los motivos se explican por sí solos. Con la llegada del nuevo milenio millones de personas adquirían nuevos ordenadores personales y se unían a internet, y cada nuevo equipo a la venta llegaba con Windows XP instalado. El sistema además no hizo sino mejorar y para los más veteranos pronto se hizo evidente que no tenía sentido seguir con versiones previas de Windows. El soporte para hardware y software crecía a buen ritmo y las mejoras introducidas terminaban por inclinar la balanza. En pocos años la mayoría de usuarios ya había hecho el cambio.

Por si fuera poco Microsoft se aseguró de mejorar el sistema con los tres Services Packs que fueron publicados posteriormente. El primero de ellos no tardaría ni un año en llegar, solucionando más de 300 pequeños errores, añadiendo todos los parches de seguridad hasta la fecha e incorporando soporte para USB 2.0 y nuevas tecnologías que pronto serían utilizadas por las ediciones Media Center y Tablet PC de Windows XP. El Service Pack 2 tardaría algo más. Llegaría el 25 de agosto de 2004 y con él el Windows Security Center además de mejoras en el soporte WiFi y Bluetooth. El tercero de los Service Packs no llegaría hasta el 2008, corrigiendo errores e incluyendo más actualizaciones de seguridad. Los tres no hicieron más que contribuir a la extraordinaria longevidad de un sistema operativo único en la historia.

Windows XP, un imperio irrepetible

Con catorce años a sus espaldas, Windows XP es el sistema operativo de Microsoft que más tiempo ha durado. Los de Redmond incluso se vieron obligados a extender su soporte más allá de los diez años inicialmente estipulados. Sus novedades, la evolución que supuso y el tremendo dominio del que llegó a hacer gala explican en gran medida su éxito, pero también lo hace la falta de un sustituto en condiciones.

Las novedades que trajo consigo, la evolución que supuso y el tremendo dominio del que Windows XP llegó a hacer gala, con más de un 80% de cuota de mercado, explican en gran medida su éxito, pero también lo hace la falta de un sustituto en condiciones

Tras Windows XP en Redmond decidieron embarcarse en Longhorn, un ambicioso proyecto que pretendía reconstruir Windows con un renovado conjunto de APIs y un nuevo sistema de archivos. Lo gigantesco de la tarea terminó haciéndose evidente más pronto que tarde y tras varios retrasos el proyecto fue finalmente abandonado en pos de una nueva versión de Windows menos ambiciosa y más conservadora: Windows Vista. El sustituto de XP nunca llegó a cuajar en el mercado y Microsoft se vio envuelta en un error del que el propio Steve Ballmer se lamentaría años después.

Windows XP se había adueñado del mercado y nada parecía poder desplazarlo. Solo la llegada de Windows 7 pudo empezar a arañar algo de cuota al aplastante dominio que XP mantenía. En su momento de más auge llegó a estar instalado en más del 80% de los ordenadores personales de todo el mundo, cifra que probablemente ningún otro sistema operativo llegue a alcanzar jamás. No habrá nunca otro sistema operativo con semejante dominio en el mercado de PCs. Pero 14 años son mucho años y ha llegado la hora de dejar descansar al viejo XP, se lo ha ganado con creces.